Технологијата има пуштено толку силни корени во нашите животи, што скоро и не знаеме како да живееме без неа. Ние бараме совети од гласовен асистент, а вештачката интелигенција (ВИ) почнува да учи сѐ што знае и умее човекот: да пече колачиња, да врши сложени пресметки и … да мрази. Всушност секоја ВИ може да стане мизантроп, тоа дирекно зависи од тоа како ќе ја подесат научниците.

На пример, програмерите од Технолошкиот институт во Масачусетс создадоа вештачка интелигенција наречена Норман, која размислува како вистински психопат и манијак, гледајќи само уништување, насилство и болка наоколу.

Со развивање на вештачка интелигенција, научниците обично велат дека би сакале да создадат машина која ќе им користи на луѓето или барем ќе ги забавува. Но, зошто роботите ги учат на зло и суровост? Креаторите на Норман објаснуваат дека ова е направено со цел детално да се изучува процесот на учење на ВИ.

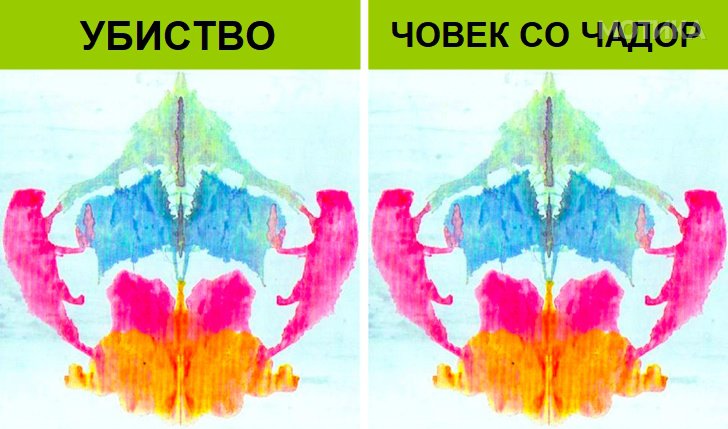

Норман ја проучувал перцепцијата на светот на овој начин: му биле прикажани фотографии, во кои се прикажани трагичните настани поврзани со смртта на луѓето. Потоа, роботот морал да ги опише зборовите што ги видел на сликите од Роршах тестот. Истовремено, научниците обучувале друга вештачка интелигенција, покажувајќи ѝ фотографии со фоки, птици и луѓе.

На оваа слика Норман видел убиството на еден човек пред неговата сопруга, додека „добрата“ вештачка интелигенција го идентификуваше ова како човек со чадор. И фактот што Норман, обучен со насилни фотографии, почнал да ги гледа ужасните слики насекаде, зборува за главниот проблем при учење на ВИ.

Според професорот на Универзитетот во Масачусетс, множеството изворни податоци се поважни од самиот алгоритам. Изборот на информации што се користат за обука на вештачката интелигенција влијае на тоа како оваа вештачка интелигенција го доживува светот околу неа и до кои заклучоци доаѓа. Со други зборови, ако ја учите ВИ на лошо, таа ќе стане лоша. Истиот факт докажува друга ситуација, која се случила со бот на Microsoft.

По само еден ден разговор со претплатници на Твитер, бот по име Тај престанал да биде пријателски настроен: во своите одговори, корисниците добиле расистички изјави, поддршка за Хитлеровите идеи и други навреди. Тие се обиделе да го реконфигурираат, но не успеале да направат значителни промени во алгоритмот, и сите навредливи твитови биле избришани, а самиот бот бил оневозможен. Заменик-претседателот на Мајкрософт поднел официјално извинување.

Интернет корисници реагирале добро на извинувањето. Некои дури сметале дека нема за што да се извини, бидејќи Мајкрософт само создал огледало на општеството.

Која била причината што ботот ги мразел сите? Факт е дека вештачката интелигенција навистина работела на принципот на огледало, анализирајќи ги прочитаните пораки на корисниците на Твитер. Грубите пораки видени од страна на ботот, направиле вештачка интелигенција да расистички настроена и да мрази. По овој инцидент, Мајкрософт одлучи да се откаже од тестирањето на ВИ во отворени области.

Што и да се случува сепак моментот кога вештачката интелигенција ќе биде на исто ниво со човекот, а потоа ќе го надмине е сè уште далеку. Но, технологијата не застанува, и не е важно, по 20 или 40 години, овој момент ќе дојде. Најважно е да се обрне внимание на формулирањето на вистинските задачи за кои се развива вештачката интелигенција. Не е препорачливо да се занемари било кој од сегашните специјалисти од областа на развојот и обуката на ВИ.